Актуальні теми

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

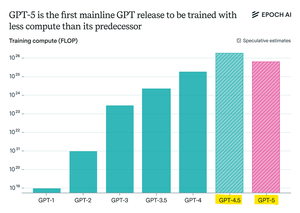

Epoch Research стверджує:

GPT-5 використовував менше попередніх тренувальних обчислень, ніж GPT-4.5, але GPT-6, швидше за все, знову буде тренуватися на більшій кількості

Це пов'язано з тим, що «міркування» про поліпшення після тренування сповільнюються,

а з доступними більшими кластерами графічних процесорів масштабування попереднього навчання знову має сенс.

openAI max-compute модель + RL буде божевільною

Найкращі

Рейтинг

Вибране