Topik trending

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

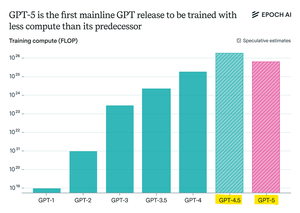

Epoch Research mengklaim:

GPT-5 menggunakan komputasi pra-pelatihan lebih sedikit daripada GPT-4.5, tetapi GPT-6 kemungkinan akan dilatih lebih banyak lagi

itu karena "penalaran" perbaikan pasca-pelatihan melambat,

dan dengan klaster GPU yang lebih besar yang tersedia, penskalaan pra-pelatihan masuk akal lagi.

openAI max-compute model + RL akan gila

Teratas

Peringkat

Favorit