المواضيع الرائجة

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

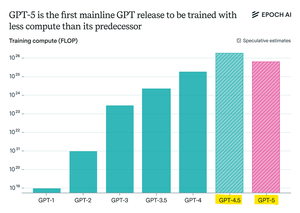

تدعي Epoch Research:

استخدم GPT-5 حوسبة ما قبل التدريب أقل من GPT-4.5 ، ولكن من المحتمل أن يتم تدريب GPT-6 على المزيد مرة أخرى

ذلك لأن تحسينات "التفكير" بعد التدريب تتباطأ ،

ومع توفر مجموعات GPU أكبر ، فإن توسيع نطاق التدريب المسبق أمر منطقي مرة أخرى.

سيكون نموذج الحوسبة الأقصى ل openAI + RL مجنونا

الأفضل

المُتصدِّرة

التطبيقات المفضلة