Populære emner

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

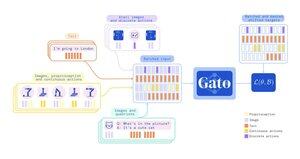

Når jeg trener multimodale omni foundation-modeller, liker jeg alltid å gå tilbake til den første generalistagenten utgitt av @scott_e_reed, @NandoDF og teamet på DeepMind, utgitt før chatGPT i mai 2022.

En 1,2B-modell, Gato, er ikke bare multimodal, men en generalistpolitikk med flere oppgaver og flere legemliggjørelser.

"Den kan spille Atari, tekstbilder, chatte, stable blokker med en ekte robotarm og mye mer, og bestemme basert på konteksten om den skal sende ut tekst, felles dreiemomenter, knappetrykk eller andre tokens."

Nando twitret "Game over" etter denne utgivelsen!

Topp

Rangering

Favoritter