Populære emner

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Ramin Hasani

LFM-er med 👂 og 👄 nyt!

Liquid AI5 timer siden

I dag utvider vi vår LFM2-familie til lyd. 👂👄

LFM2-Audio er en ende-til-ende lyd-tekst omni foundation-modell, og leverer responsiv sanntidssamtale på enheten med bare 1,5 milliarder parametere.

Én modell. Sømløs multimodal støtte. Ingen kjeder.

> Tale-til-tale

> Tale-til-tekst

> Tekst-til-tale

> Lydklassifisering

> Åpne vekter

10 ganger raskere slutning sammenlignet med jevnaldrende, med kvalitetskonkurrerende systemer 10 ganger større.

1/n 🧵

1,27K

Når jeg trener multimodale omni foundation-modeller, liker jeg alltid å gå tilbake til den første generalistagenten utgitt av @scott_e_reed, @NandoDF og teamet på DeepMind, utgitt før chatGPT i mai 2022.

En 1,2B-modell, Gato, er ikke bare multimodal, men en generalistpolitikk med flere oppgaver og flere legemliggjørelser.

"Den kan spille Atari, tekstbilder, chatte, stable blokker med en ekte robotarm og mye mer, og bestemme basert på konteksten om den skal sende ut tekst, felles dreiemomenter, knappetrykk eller andre tokens."

Nando twitret "Game over" etter denne utgivelsen!

13,87K

Innen 2027 er ~$1.1T til ~$1.6T kapital planlagt distribuert på datasentre! Selv om dette er spennende og viktig, trenger økonomien en nærmere titt.

med dagens ~30-40 % AI-vekstmarginer, blir disse dollarene betalt tilbake innen 2033, bare hvis effektiviteten fortsetter å forsterkes, AI blir bedre og kravene fortsetter å øke.

Den bærekraftige veien er hybrid: skyv så mye slutning som mulig til enheter, eskalere bare de tunge tingene til skyen. Programvaremarginen på enheter er rundt 70-90 % med mye lavere pågående capex.

Mer på enheten:

> mer privat

> raskere

> grønnere

> og betydelig bedre enhetsøkonomi.

Med Nanos som leverer resultater på frontlinjenivå på spesialiserte oppgaver, og kjører lokalt på enheter, er dette vårt første skritt mot global skala, enhetssky-AI som er både tilgjengelig og økonomisk fornuftig.

La oss flytte mediantokenet til kanten!

💧⚛️

Liquid AI25. sep. 2025

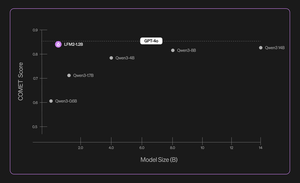

Vi introduserer Liquid Nanos ⚛️ – en ny familie av ekstremt små oppgavespesifikke modeller som leverer ytelse i GPT-4o-klassen mens de kjører direkte på telefoner, bærbare datamaskiner, biler, innebygde enheter og GPUer med lavest ventetid og raskeste generasjonshastighet.

> modellstørrelse: 350M til 2.6B

> bygget på LFM2, vår v2-effektive modellarkitektur

> presterer konkurransedyktig med modeller som er opptil hundrevis av ganger større

> muliggjør kjerneagentoppgaver: presis datautvinning, flerspråklig oversettelse, verktøykall, matematikk og RAG. 1/n

12,25K

Topp

Rangering

Favoritter