Topik trending

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Memperkenalkan Liquid Nanos ⚛️ — rangkaian baru model khusus tugas yang sangat kecil yang menghadirkan performa kelas GPT-4o saat berjalan langsung di ponsel, laptop, mobil, perangkat tertanam, dan GPU dengan latensi terendah dan kecepatan generasi tercepat.

> ukuran model: 350M hingga 2.6B

> dibangun di atas LFM2, arsitektur model efisien v2 kami

> berkinerja kompetitif dengan model hingga ratusan kali lebih besar

> mengaktifkan tugas agen inti: ekstraksi data yang tepat, terjemahan multibahasa, panggilan alat, matematika, dan RAG. 1/n

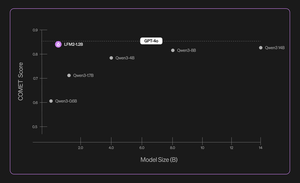

Kami menggunakan kombinasi metode untuk evaluasi otomatis, penyulingan pengetahuan, RL, dan penggabungan model untuk meningkatkan kinerja model secara berulang pada tugas tertentu. Model yang dihasilkan, meskipun kecil, berkinerja kompetitif untuk model yang jauh lebih besar. 2/n

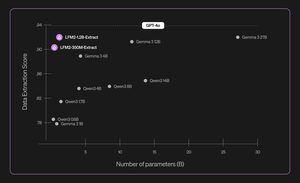

Misalnya, LFM2-350M-Extract dan LFM2-1.2B-Extract dirancang untuk mengekstrak informasi penting dari berbagai macam dokumen tidak terstruktur (seperti artikel, transkrip, atau laporan) ke dalam output terstruktur seperti JSON, XML, atau YAML. Mereka kompatibel dengan input Inggris, Arab, Cina, Prancis, Jerman, Jepang, Korea, Portugis, dan Spanyol.

Model ekstraksi data kami memberikan peningkatan yang signifikan dalam validitas, akurasi, dan kesetiaan. Misalnya, LFM2-1.2B-Extract dapat menghasilkan objek kompleks dalam bahasa yang berbeda pada tingkat yang lebih tinggi dari Gemma 3 27B, model 22,5 kali ukurannya dan mendekati kinerjanya ke GPT-4o. 3/n

Kami mengumumkan enam Nano khusus tugas dalam rilis awal kami:

> LFM2-Extract – Model multibahasa 350M dan 1.2B untuk ekstraksi data dari teks tidak terstruktur, seperti mengubah email faktur menjadi objek JSON.

> LFM2-350M-ENJP-MT – Model 350M untuk terjemahan bahasa Inggris ↔ Jepang dua arah.

> LFM2-1.2B-RAG – Model 1.2B yang dioptimalkan untuk menjawab pertanyaan konteks panjang dalam alur RAG.

> LFM2-1.2B-Tool – Model 1.2B yang dibuat untuk pemanggilan fungsi dan penggunaan alat agen.

> LFM2-350M-Math – Model penalaran 350M untuk memecahkan masalah matematika.

4/n

"Saya merasa sangat mengesankan bahwa teknik pra-pelatihan dan pasca-pelatihan baru Liquid memungkinkan LLM mereka yang cepat dan kecil untuk bekerja setara dengan model perbatasan seperti GPT-4o, yang lebih besar, pada tugas-tugas khusus," kata Mikhail Parakhin (@MParakhin), CTO, Shopify. "Liquid secara bersamaan meningkatkan standar untuk kinerja dan kecepatan dalam model pondasi, melampaui canggih. Itulah mengapa kami sangat senang memanfaatkan model mereka di seluruh platform dan layanan Shopify." 5/n

"Deloitte sangat senang dengan kesempatan untuk berkolaborasi dengan Liquid AI dan model Nanos baru mereka, yang memiliki potensi untuk mendorong kinerja yang sebanding dengan model yang lebih besar dengan biaya lebih rendah," kata Ranjit Bawa (@ronbawa), Chief Strategy and Technology Officer, Deloitte U.S. 6/n

"Nanos Liquid mewakili titik infleksi yang kuat untuk PC AI, menghadirkan kinerja tingkat perbatasan dalam bentuk yang ringkas dan hemat energi. Di AMD, kami berbagi fokus pada kepemimpinan kinerja per watt dan melihat kecerdasan di perangkat sebagai kunci untuk menskalakan AI secara luas dan berkelanjutan," kata Mark Papermaster (@mpaper2000), CTO dan EVP, AMD. 7/n

560,96K

Teratas

Peringkat

Favorit