Populære emner

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Dykk ned i @nvidia 🐰 Hopper vs ⚙️ Blackwell GPU-arkitekturer – påfølgende sprang i datakraft og sammenkoblinger for AI-arbeidsbelastningene👇 dine

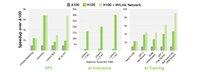

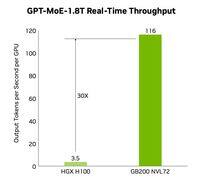

🐰 Hopper (H100 og H200) introduserte 4.-generasjons Tensor-kjerner + en FP8-transformatormotor, noe som gir opptil 9× raskere trening og 30× raskere slutning sammenlignet med A100.

⚙️ Blackwell (B200) – leveres sent i 2024 – parer to dyser over en 10 TB/s NV-HBI, legger til FP4 og bruker NVLink-5 for opptil 30 × klyngeslutning.

@nvidia 🐰 Beholder-spesifikasjoner

Tensorkjerner: blandet FP8/FP16/TF32

Hukommelse:

- H100 → 80 GB HBM3 @ 3,35 TB/s

- H200 → 141 GB HBM3e @ 4,8 TB/s

NVLink: opptil 900 GB/s per GPU

@nvidia 🐰 Hopper i aksjon

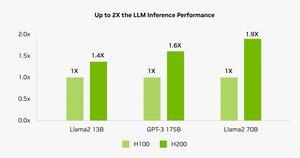

Benchmarks viser at H200 driver Llama-2 70B-slutning 45–100 % raskere sammenlignet med H100.

⚠️ Begge så forsyningskriser i 2023–25.

💻 På Hyperbolics sky: H100 VM-er og bare-metal-klynger med Ethernet + InfiniBand som starter på $1.49/t. H200 & B200 via øyeblikkelig tilbud.

@nvidia Blackwell-innovasjoner ⚙️

- Chiplet-design (TSMC 4NP, 208 B-transistorer, 10 TB/s NV-HBI)

- 2. generasjons transformatormotor: FP4 + forbedret FP8

- NVLink-5: 18 lenker @ 1,8 TB/s totalt

- Dekompresjonsmotor: 800 GB/s CPU↔GPU

- Full RAS og konfidensiell databehandling

📊 Sammenligning av ytelse

H100 SXM: 80 GB @ 3,35 TB/s, 3,96 PFLOPS (FP8), 1,98 PFLOPS (FP16), 67 TFLOPS (FP32), NVLink 900 GB/s, 700 W

H200 SXM: 141 GB @ 4,8 TB/s, PFLOPS/TFLOPS med samme databehandling, NVLink 900 GB/s, 700 W

HGX B200: 180 GB @ 7,7 TB/s, 9 PFLOPS (FP8), 4,5 PFLOPS (FP16), 75 TFLOPS (FP32), NVLink 1,8 TB/s, 1000 W

@nvidia ❓ Hva er en FLOP?

1 flyttallsoperasjon (legg til/mul)

1 TFLOP = 10¹² operasjoner/s

1 PFLOP = 10¹⁵ ops/s = 1000× en TFLOP

Disse beregningene viser hvor raskt GPU-er knuser den massive matematikken bak AI-trening og HPC.

@nvidia 🔚 Innpakning:

🐰 Hopper satte standarden med FP8 blandet presisjon og asynkrone rørledninger.

⚙️ Blackwell presser neste generasjon med FP4, mer minne, NVLink-5.

H100 er fortsatt arbeidshesten – leie via $1.49/time.

H200 og B200 tilgjengelig på forespørsel via

@nvidia Les hele artikkelen på:

6,98K

Topp

Rangering

Favoritter